小龙虾使用本地算力进行推理(不需要支付API token费用)

⚓ 抓虾指南 📅 2026-03-27 👤 rico_admin 👁️ 63OpenClaw开启多个skill之后,上下文窗口巨长无比,如果采用的是云厂商的API接口,钱包太容易被烧光了。我推荐采用70b(700亿参数)规模的模型作为核心AI推理引擎,硬件则购买英伟达的DGX Spark进行部署,一次投入,终身免去Token账单费用:

推荐开源社区发烧友程序员提供一键部署脚本,仅需要三步,您就能抓住一只自己的小龙虾:

第一步:克隆项目仓库

git clone https://github.com/HeKun-NVIDIA/dgx-spark-openclaw.git

第二步:一键安装环境与模型

cd dgx-spark-openclaw ; ./install.sh

第三步:启动所有服务

start_all

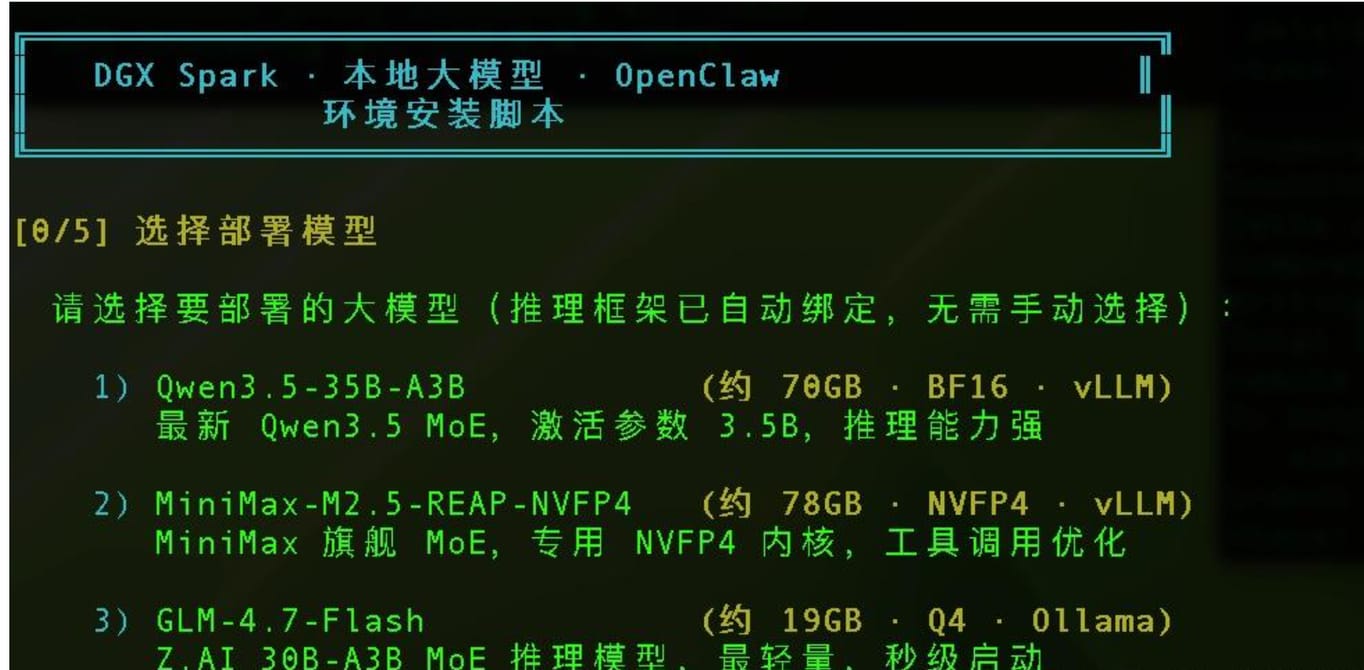

该脚本默认配置了三款国产大模型:

推荐选择MiniMax-M2.5

更多配置参考:

https://github.com/HeKun-NVIDIA/dgx-spark-openclaw/blob/main/docs/deployment_guide.md

🏷️ dgx spark

🏷️ dgx-spark

🏷️ nviida

🏷️ openclaw